ظهور ماشینها: بررسی یارانش شناختی در امنیت سایبری

پیشرفت های تکنولوژِی اخیر و هوش مصنوعی

در سال 1329 شمسی دانشمند پیشگام در امر رایانه، آلن تورینگ “تست تورینگ” را با هدف سنجش توانایی ماشین برای نشان دادن رفتاری هوشمندانه که شبیه رفتار انسان باشد، ابداع کرد. قصد تورینگ در اصل این بود که تشخیص بدهد آیا ماشینها توانایی این که خودشان فکر کنند را دارند یا خیر.

تقریبا 10 سال بعد، مخترع امریکایی هوش مصنوعی و بازیهای کامپیوتری آرتور لی ساموئل اصطلاح “یادگیری ماشینی” را ابداع کرد که “رشتهای از مطالعات است که به کامپیوتر توانایی یاد گرفتن را بدون نیاز به برنامهنویسی صریح میدهد.” در دهه 90 میلادی کار بر روی یادگیری ماشینی از رویکرد مبتنی بر دانش به رویکرد مبتنی بر داده تغییر پیدا کرد و دانشمندان شروع به طراحی برنامههای کامپیوتریای کردند که بتوانند با تحلیل حجم زیادی از اطلاعات، نتایجی را از آن استخراج کنند. نکته این است که مفهوم رایانش شناختی، مفهوم تازهای نیست.

اما در حال حاضر ما در عصری زندگی میکنیم که پیشرفتهای تکنولوژیکی اخیر و انفجار دادههای در دسترس، درها را به روی امکانات جدیدی از یادگیری ماشینی باز کرده و انتظارات را در این زمینه افزایش دادهاند. این شاخه از هوش مصنوعی تأثیرات زیادی بر زندگی روزمره ما داشته است، از کمک به پزشکان در تشخیص دقیقتر و مؤثرتر گرفته تا حملونقل خودکار با بهرهوری بیشتر و یا ایجاد ابداعاتی در علوم مختلف از جمله سیستمهای تشخیص چهره و صدا.

بنابراین جای تعجب نیست که به کار بستن متدهای یادگیری ماشینی در حوزه امنیت اطلاعات، طی چند سال گذشته سرعت قابل توجهی داشته است و مشاغل، فروشندگان و کاربران به دنبال روشهایی برای استفاده از این الگوریتمهای رو به تکامل در راستای حفاظت از دادهها هستند.

John Bruce مدیرعامل Resilient میگوید: “یادگیری ماشینی میتواند ابزار قدرتمندی برای امنیت سایبری باشد. امروزه ما با حملات سایبری پیچیده، محیطهای تکنولوژیکی و کسبوکارهای پیچیدهای روبهرو هستیم و در زمینه مهارتهای لازم در این حوزهها کمبود بسیار زیادی داریم. راهکارهای شناختیای که از یادگیری ماشینی استفاده میکنند و در یک تابع پاسخ امنیتی مناسب ادغام شده باشند، پتانسیلهای بیشماری دارند.”

اما این پتانسیل در چشمانداز امنیتی امروز چطور پیادهسازی میشود و جهت حرکت آن به چه صورت است؟

رویکردی مترقی و تحول آفرین

Stuart Aston افسر امنیت ملی Microsoft UK در مصاحبهای با وبسایت Infosecurity این طور توضیح داده که خطرات سایبری آنقدر پیشرفته شدهاند که لازم است در استراتژی امنیت سایبری شرکتها از تکنولوژیهای تحول آفرینی مثل یادگیری ماشینی استفاده شود.

وی میگوید “برای سازمانها بسیار حیاتی است که شجاعت به خرج داده و یک مدل امنیتی جدید و پیشرفته را پیادهسازی کنند تا بتوانند با خطرات جدید روز مقابله کنند. یادگیری ماشینی نقش کلیدیای در پیشرفتهتر کردن شیوههای محافظت از سازمانها و حرکت به سوی روشهای پیشرفته دارد.”

او اضافه میکند که این امر شامل بهرهگیری از اطلاعات مربوط به حملاتی است که پیش از این در سیستم یک سازمان صورت گرفتهاند؛ این کار با استفاده از موتورهای تحلیل، برای ایجاد فهم و آگاهی نسبت به خطرات و در اختیار گرفتن قدرت یادگیری ماشینی برای ایجاد سیستمی انجام میشود که خودش یاد میگیرد و به صورت بلادرنگ رشد و تکامل پیدا میکند.

Aston ادامه میدهد “ما در شرکت مایکروسافت از هوش (مصنوعی) در پلتفرمهای امنیتی خودمان استفاده میکنیم تا قدرت محافظت از هویت افراد، اپلیکیشنها، دادهها و دستگاهها را افزایش داده و با ارائه اطلاعات سریع و جامع به مشتریانمان قدرت آنها را برای مقابله با خطرات (با شناسایی فعالیتهای مشکوک و تشخیص تلاش برای دسترسی به دادههای حساس افراد) افزایش دهیم.”

به این ترتیب نرمافزارها یک مرحله پیشرفتهتر میشوند، خطرات را به مدیران امنیتی تعیین شده اعلام میکنند و توصیههایی برای پیشگیری از خطر ارائه میدهند.

“این تکامل مداوم و همیشگی به سازمانها کمک میکند تا همیشه یک گام جلوتر از مهاجمین باشند و با استفاده از یادگیری ماشینی، سیستمها را قادر به شناسایی سریعتر الگوهای خطر میکند تا بتوانند پاسخگویی سریعتری داشته باشند.”

” راهکارهای شناختیای که از یادگیری ماشینی استفاده میکنند و در یک تابع پاسخ امنیتی مناسب ادغام شده باشند، پتانسیلهای بیشماری دارند.”

نیاز به یادگیری پرسرعت

به این ترتیب به عنصر مهم بعدی یعنی سرعت میرسیم. امروزه سازمانها با حجم غیرقابل پیشبینی از دادههای مختلف سروکار دارند و باید برای دستیابی به موفقیتهای کاری، آنها را به شیوهای مناسب و امن مدیریت، تجمیع و ترکیب کنند، این امر به معنای نیاز به قابلیت انتخاب سریع و اقدام به موقع بر اساس خطرات و ناهنجاریها است. اما واقعیت اینجاست که برای اکثر مشاغل، استدلال چنین دادههایی و استفاده از آن در راستای تقویت امنیت واقعا غیرممکن است چه برسد به این که قرار باشد این کار را با سرعت بالا انجام دهند.

اما با این وجود در دنیای کسب و کار که رقابت در آن بهشدت بالا است، عبارت “هر که سریعتر یاد بگیرد پیروز میشود” مفهوم بسیار زیادی دارد و استفاده از فرایند یادگیری و استدلال در روشهای امنیتی ماشینی روزبهروز بیشتر میشود.

Bruce توضیح میدهد که چطور میتوان از یادگیری ماشینی در عصر امروزی برای صرفهجویی در زمان، استفاده کرد که پاسخگویی به حملات توسط مشاغل طولانیتر شده (مطالعه جهانی اخیر موسسه Ponemon مشخص کرد که در 41 درصد از سازمانهای بررسی شده، زمان پاسخگویی به حملات افزایش پیدا کرده است) و حجم کار موردنیاز علیرغم محدودیت نیروی انسانی و منابع، در حال افزایش است.

او میگوید: “میتوان اقدامات سطح پایین واکنشیای مثل کوئریهای SIEM، جستجوهای لازم برای اطلاع یافتن از خطرات یا ایجاد تیکتهای IT را به صورت خودکار انجام داد.” همچنین یکی دیگر از تأثیرات این فناوری، شناسایی موارد مثبت کاذب است، Bruce ادامه میدهد: “طبق گزارش Cyber Security Intelligence Index شرکت IBM در سال 1394، سازمانها به طور میانگین 21هزار ساعت را در سال صرف شناسایی موارد منفی کاذب میکنند.” پلتفرمهای یادگیری ماشینی مثل IBM Watson به شناسایی مؤثرتر موارد مثبت کاذب کمک میکنند.

Mike Banic معاون رییس بازاریابی شرکت Vectra اضافه میکند “زمان لازم برای بررسی یک هشدار امنیتی ممکن است ساعتها و گاهی اوقات روزها به طول بیانجامد، در عین حال حمله به صورت بلادرنگ و لحظهای انجام میشود… با استفاده از یادگیری ماشینی میتوانیم سیستم را طوری آموزش بدهیم که به دنبال ویژگیهای خیلی خاصی باشد و به تحلیلگران امنیتی کمک کند تا تشخیص بدهند آیا مهاجم از طریق تروجانی با دسترسی از راه دور حمله را کنترل میکرده، یا وارد یک هاست شده و در حال انجام اقدامات مقدماتی است، یا اطلاعات کاربری خاصی را برای دسترسی به دادههای حساس به سرقت برده است و غیره.”

Banic میگوید شناسایی این موارد در حالت معمولی نیاز به ساعتها یا روزها کار انسانی بر اساس مشاهده شواهد کوچک دارد، در حالیکه با یادگیری ماشینی، این کار به صورت بلادرنگ قابل انجام است. یادگیری ماشینی میتواند کارهایی را انجام بدهد که بهشدت زمانبر و سخت هستند و متخصصین امنیت را یک گام جلوتر از مهاجمین قرار میدهد.

“یادگیری ماشینی میتواند نقشی کلیدی در پیشرفته کردن شیوههای محافظت از سازمانها و حرکت به سمت رویکرد پیشگیرانه ایفا کند.”

یک سؤال مهم

آنچه واضح و مشخص است این است که کمپانیها باید (و در خیلی موارد نیاز دارند که) پذیرای پیادهسازی یادگیری ماشینی و شناسایی قابلیتهای آن و تمام مزایای آن برای استراتژیهای امنیتی خودشان باشند. سرعت، بهرهوری، از بین بردن خطر، تشخیص دقیق و غیره؛ پتانسیلهای این حوزه بسیار متنوع و گسترده هستند و آنقدر زیاد هستند که میتوانند سازمانها را تشویق به استفاده از یادگیری ماشینی جهت تقویت امنیت خودشان کنند.

اما برای انجام مؤثر این کار لازم است ارزش آن را در تقابل با چندین فاکتور دیگر هم بسنجیم.

Ilia Kolochenko مدیرعامل شرکت امنیت وب High-Tech Bridge به وبسایت Infosecurity اعلام کرده: “اول از همه لازم است که کمپانیها دلیل پیادهسازی یادگیری ماشینی را مشخص کنند. اگر یک کمپانی چشمانداز روشنی از مزایای مستقیم این فناوری نداشته باشد، نه تنها یادگیری ماشینی برای آن بی استفاده است بلکه میتواند مضر هم باشد. به علاوه به دلیل منابع مورد نیاز یادگیری ماشینی برای پردازش و ذخیره سازی دادهها، این فناوری میتواند پرهزینه باشد. بنابراین در صورتی که در حال حاضر بدون استفاده از یادگیری ماشینی میتوانید به نحو مؤثر و کارآمدی مشکلاتتان را حل کنید، به همین روش ادامه بدهید!”

همچنین آنطور که Oliver Tavakoli، مدیر ارشد فناوری شرکت Vectra Networks امسال در نمایشگاه امنیت اطلاعات اروپا (Infosecurity Europe) توضیح داد شناسایی دقیق منشأ تولید دادهها و مجاز بودن آنها اهمیت بسیار زیادی دارد. ممکن است این دادهها توسط مهاجمینی که سیستمهای امنیتی مبتنی بر یادگیری ماشینی را هدف میگیرند، ایجاد شده باشند. هدف این مهاجمین ایجاد اختلال در قابلیت نتیجهگیری درست و دقیق این الگوریتمها است که منجر به ایجاد نتایج نادرست و ناقص میشود.

او در این رویداد اعلام کرد “در واقع کاری که در یادگیری ماشینی انجام میشود، استفاده از دادهها برای آموزش دادن یک سیستم کامپیوتری است. بنابراین دادهها میتوانند الگوریتم را آموزش داده یا از طرفی آن را گول بزنند. بنابراین باید در رابطه با منشأ دادهها بسیار محتاط عمل کنید.” پس کمپانیهایی که به دنبال خریداری پلتفرمهای یادگیری ماشینی آماده هستند باید اول از همه بپرسند چه دادههایی به عنوان ورودی استفاده میشوند، منشأ تولید آنها چیست و باید از خلوص و اعتبار این دادهها نیز مطمئن شوند.

اما آنهایی که سعی دارند خودشان این پلتفرمها را تولید کنند، باید تیمهای متخصص داده قابل اطمینانی داشته باشند تا این اطمینان وجود داشته باشد که فرایند جمعآوری دادهها صحت و تمامیت لازم را دارد و مشخص کنند که آیا این دادهها شامل ویژگیهای مناسب و درستی برای کاربردهای مورد نظر هستند یا خیر.

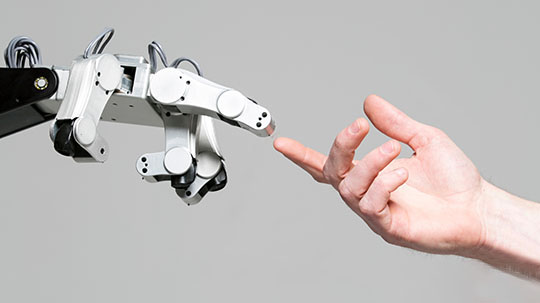

Aston به عنوان یک نکته مهم به این موضوع اشاره میکند که انسانها و ماشینها برای موفقیت باید با هم کار کنند نه در مقابل هم. وی در ادامه به ارزش بسیار زیاد انسان و روابط او با این الگوریتمهای مستقل اشاره میکند و میگوید: “متخصصین انسانی، در کنار الگوریتمهای ماشینی نقش مهمی در فرایند محافظت از مشتریان دارند.”

“ما انسانها خلاقیت، همدلی، احساسات، ویژگیهای فیزیکی و ادراکاتی داریم که میتوان آنها را با قدرت محاسبات هوش مصنوعی ترکیب کرد تا بتوان دادههایی با حجم بسیار زیاد را در زمینههای مناسب به کار بست. این امر باز هم اهمیت عنصر انسانی و تخصص لازم برای بهرهگیری حداکثری از دادهها را برجستهتر میکند و نشان میدهد نقش افراد حرفهای آموزش دیده در این حوزه در سالهای پیش رو چقدر مهمتر و حیاتیتر خواهد شد.”

موضعگیری علیه یادگیری ماشینی

احتمالا همانطور که Aston توضیح میدهد، یک عنصر انسانی خاص باعث ایجاد مهمترین و مشکلآفرینترین مسئلهای شده که تکنولوژی یادگیری ماشینی با آن روبهرو است؛ این عنصر، تعصب اخلاقی و ناتوانی کامپیوترها (صرفنظر از قدرت پردازششان) در تصمیمگیریهای اخلاقی شبیه به تصمیمگیریهای اخلاقی ذهن انسانهاست. مسائلی مثل هزینه، ارزشهای شغلی و صحت و اعتبار دادهها مسائل مهمی هستند، اما Ottenheimer توضیح میدهد که مسئله اخلاقی در حال حاضر یکی از بزرگترین مشکلاتی است که حوزه یادگیری ماشینی را احاطه کرده است.

وی هشدار میدهد که “از یادگیری ماشینی به روشهایی استفاده میشود که قابلیت در نظر گرفتن تعصبات اخلاقی را ندارد و این امر میتواند منجر به ایجاد نتایج غیراخلاقی و سردرگمی و ابهام درباره مسئولیت آسیبهای احتمالی ایجاد شده شود.”

Ottenheimer به چندین مثال از زندگی واقعی اشاره میکند که در این موارد تصمیمگیریهای مستقل و خودمختار ماشینها منجر به ایجاد نگرانیهای اخلاقی شده است. برای مثال جستجوی آنلاین عباراتی مثل “مدل موی حرفهای” (professional hairstyle) فقط تصویر افراد سفید پوست را بر میگرداند، یا گاهی اوقات فردی به اشتباه و بر اساس کلیشههای نژادی به عنوان مجرم برچسب گذاری میشود یا انتظارات نادرست از قابلیتهای کنترلی سیستم کروز و تکنولوژی کمک به حفظ ماشین بین خطوط، منجر به تصادفات کشندهای شده است.

“خطر نژاد پرستی [برای مثال] مشهود است. اما آنچه که کمتر مشهود و قابل درک است سرعت بخشیدن به اشتباهات انسانی توسط ماشینهاست و این که ماشینها بهاندازه انسانها قادر به برطرف کردن و اصلاح خطاهای خودشان نیستند.”

“برای مثال ممکن است شاهد باشیم که یک ماشین 100 بار یک خطای خاص را تکرار میکند و به جای این که متوجه شود کاری که انجام میدهد بد است، همچنان به یادگیری به روشهای مخرب و مضر ادامه میدهد.”

این موضوع نشان میدهد که با ادامه رشد و تکامل تکنولوژیهای یادگیری ماشینی و افزایش قدرت آنها، ورودیهای انسانی چقدر اهمیت پیدا میکنند. Whilst Tavakoli این طور استدلال میکند که “هر تکنولوژی ممکن است منجر به ایجاد سؤالات اخلاقیای شود.” بسیار مهم است که ما به این باور برسیم که ممکن است چنین نقایصی حتی به صورت غیر عمدی به تکنولوژی رخنه کنند و ما به عنوان متخصصین امنیت باید بتوانیم این تضمین را ایجاد کنیم که به نحو مؤثری با این مسائل مقابله کرده و آنها را اصلاح کنیم تا امکان رخنه کردن این نقایص در حوزه امنیت سایبری، وجود نداشته باشد.

Ottenheimer اضافه میکند “نکته حائز اهمیت در زمینه امنیت این است که این حوزه هم مثل هر ابزار اتوماسیون دیگری که امکان استفاده از آن برای مقاصد خوب و بد وجود دارد، برای یادگیری مسیر مناسب و مدیریت خروجی ایجاد شده است. به یادگیری ماشینی مثل یک کودک و به فردی که با آن کار میکند مثل پدر یا مادر او نگاه کنید. لازم است در مورد چیزهایی که به آن (ماشین یا انسان) آموزش میدهیم محتاط باشیم تا از تصمیماتی که منجر به نتایج مخربی میشوند پیشگیری کنیم.”

یک پشتیبان و حامی نَه ابرقهرمان

به نظر میرسد وقتی بیل گیتس گفت “یک پیشرفت غیرمنتظره در یادگیری ماشینی ممکن است ده برابر مایکروسافت ارزش داشته باشد” حتما از چیزی اطلاع داشته و هر چند به نظر میرسد هنوز پتانسیلهای کامل یادگیری ماشینی مشخص و محقق نشده (Tavakoli این طور استدلال کرده که “ما هنوز بیشتر از 25 درصد این راه را طی نکردهایم که البته همین رقم هم بیش از حد خوشبینانه است”) اما با این وجود همین حالا هم مزایای مهمی از به کار بردن این تکنولوژی در حوزه امنیت مشاهده شده است.

Aston میگوید “در سالهای پیش رو تکنولوژی هوشمندتر میشود، تکامل بیشتری پیدا میکند و با ارائه تکنیکها و قابلیتهای جدید، جان تازهای به صنعت امنیت میبخشد و مزایای استفاده از این فناوری برای کسانی که در حال حاضر از آن استفاده نمیکنند آشکارتر میشود.”

اما نباید یادگیری ماشینی را یک راهکار امنیتی دانست؛ این تکنولوژی بیشتر یک نوع پشتیبانی هوشمندانه است – بیشتر یک حامی و کمک کننده است نه یک ابرقهرمان. تا مدتها به این فکر میکردیم که آیا ظهور ماشینهایی که به صورت فزایندهای کارهای انسانها را انجام میدهند، باعث بیکار شدن و کنار گذاشتن انسانها میشوند یا خیر. هر چند این موضوع در برخی زمینهها تحقق پیدا کرده اما به نظر میرسد حوزه امنیت اطلاعات مثل یک چاه بیانتها از تغییرات و تکاملات مختلفی است که در آن یادگیری ماشینی و هوش مصنوعی، متخصصین امنیتی را توانمندتر میسازند نه اینکه جایگزین آنها شوند.

اقدامات مورد نیاز

همچنان که ما به بررسی استفاده از یادگیری ماشینی در محیطهای شرکتی میپردازیم، نمیتوانیم روشهای سواستفاده از تکنولوژی توسط طرفهای مخرب را نادیده بگیریم.

Ilia Kolochenko میگوید “مجرمین سایبری از یادگیری ماشینی برای انجام کارهای طبقهبندی (classification) مختلف با هدف انتخاب قربانیان و هدفگیری آنها استفاده میکنند. همچنین این افراد از بعضی از المانهای یادگیری ماشینی برای شناسایی دادههای ارزشمند بین حجم انبوه اسناد به سرقت رفته استفاده میکنند.”

به علاوه، کشورها و شرکتهای خلافکار که قصد حمله به کاربران را دارند علاقه زیادی به استفاده از این روشها دارند و آن طور که Oliver Tavakoli توضیح میدهد احتمال استفاده از تکنولوژیهای جدید توسط چنین نهادهایی بیشتر از بعضی سازمانها است.

“این نهادهای خلافکار در استفاده از تکنولوژیهای جدید سرعت عمل زیادی دارند و همواره در حال ابتکار راهکارهای مجرمانه جدید هستند. بنابراین لازم است که شما هم همیشه مسلح باشید چون با دشمنی روبرو هستید که از بیشتر ابزارهای در دسترس شما استفاده میکند. استفاده نکردن از یادگیری ماشینی به منزله تسلیم این ابزار به دشمن است که به هیچ عنوان گزینه خوبی محسوب نمیشود.”

پیشنهاد ما به شما مطالعه مقاله: کاربرد پردازش زبانهای طبیعی در حوزه امنیت سایبری